Meta da el salto a las gafas con IA

Cuando Meta lanzó sus Ray-Ban Meta Smart a finales de 2023 la acogida del mercado fue relativamente tibia. Unas gafas con cámara que hacían fotos y vídeos sonaban más a juguete para influencers que al gadget definitivo. Y eso sin tener en cuenta las cuestiones de privacidad. Sin embargo, algo cambió en diciembre de ese año. La empresa matriz de Facebook anunció que iba a integrar funcionalidades de inteligencia artificial multimodal, en la línea de lo que está haciendo Google con su IA Gemini. En la práctica, eso significaba que las gafas, además de responder a comandos básicos y grabar vídeos o hacer fotos, ahora empezarían a analizar las imágenes y ofrecer funcionalidades impensables hasta la fecha.

¿Qué es la inteligencia artificial multimodal?

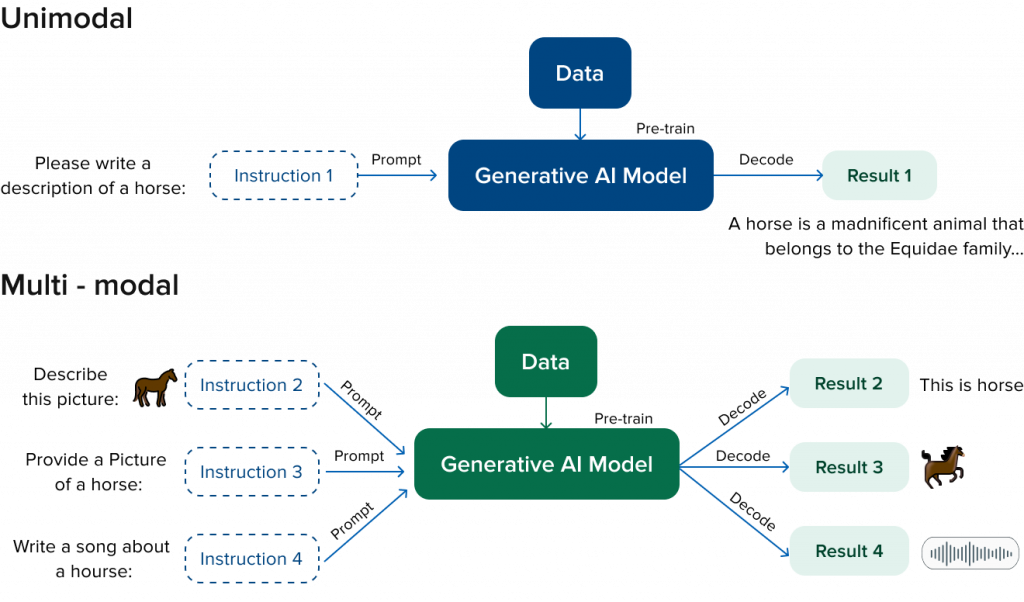

Fuente: Amazinum

La inteligencia artificial multimodal se está perfilando como la nueva frontera en el desarrollo de sistemas de IA, combinando y procesando múltiples tipos de datos, como texto, imagen, sonido y vídeo, para entender y actuar en el mundo de una manera más compleja y ambiciosa.

A diferencia de los sistemas unimodales, que se especializan en un solo tipo de datos, la IA multimodal puede interpretar información compleja de varias fuentes simultáneamente, lo que le permite realizar tareas con un nivel de comprensión y precisión sin precedentes.

En el caso de las gafas inteligentes ya no es preciso introducir comandos de texto o de voz, dado que analizan la escena que está viendo el usuario y ofrecen información sobre la base de esa misma imagen. Las aplicaciones son inagotables.

¿Qué permite hacer la nueva generación de gafas?

Las gafas de Meta y de otras empresas como Brilliant Labs o Envision suelen requerir la conexión a un smartphone que se encarga de la computación pesada. Por ahora, los modelos en el mercado se limitan a analizar fotografías. Una vez que la IA multimodal procesa la imagen, permite hacer cosas como las siguientes:

- Ofrecer sugerencias de recetas basándose en los ingredientes que hay en el frigorífico.

- Detallar los valores nutricionales de un alimento.

- Indicar la tienda donde se puede comprar una prenda de ropa o un objeto.

- Diagnosticar una avería doméstica y posibles soluciones.

- Identificar plantas o animales.

- Leer y traducir textos.

- Traducir a interlocutores que hablan en otros idiomas.

Algunas de estas aplicaciones como la generación de recetas están ya disponibles, mientras que el resto –y algunas que aún desconocemos– irán haciéndose realidad gradualmente. Por ejemplo, el modelo de gafas de Brilliant Labs incorpora una pantalla micro-OLED que permite aplicaciones de realidad aumentada como ver un sofá en un color distinto. Dicho esto, hay un área en que este tipo de dispositivos podrían llegar a cambiar vidas.

Un salto en accesibilidad

Quienes no han tardado en apreciar su potencial han sido las personas con problemas de visión o ceguera. A partir de ahora, una persona podrá preguntar por lo que tiene delante de los ojos, ya se trate de un objeto, un ser humano o un texto, y las gafas se encargarán de explicárselo.

De hecho, aparte de las gafas con IA, se están desarrollando wearables parecidos que prescinden de las lentes y funcionan por medio de unos auriculares equipados con cámaras.

Referencia: imnovation-hub