En contra de lo que pudiera pensarse, la inteligencia artificial no nació con ChatGPT. Tampoco lo hizo cuando, hace ahora más de diez años, los algoritmos de aprendizaje profundo demostraron por primera vez que eran capaces de completar las tareas que se les asignaban (por ejemplo, reconocer objetos en una imagen) con mucha mayor eficacia que cualquier otro software.

Aunque estos dos hitos son sin duda de crucial importancia, la historia de la inteligencia artificial, por otra parte, comienza hace muchas décadas, cuando el mundo aún luchaba contra la Segunda Guerra Mundial. Por lo tanto, esta tecnología tardó mucho tiempo en desarrollarse, a pesar de que los fundamentos teóricos que aún hoy sustentan todos los sistemas de aprendizaje profundo más avanzados ya existían desde el principio.

Estos son los diez hitos más importantes que ha tenido que superar la inteligencia artificial para dar lugar a la revolución digital en la que hoy estamos inmersos.

1943: la primera red neuronal artificial

En un artículo académico, el psicólogo cognitivo Walter Pitts y el experto en cibernética Warren McCulloch demuestran cómo un sistema de neuronas artificiales puede aprender del mismo modo que los humanos. La teoría expuesta por Pitts y McCulloch sigue siendo hoy la base de los algoritmos de aprendizaje profundo.

En resumen, los dos científicos demuestran que, a través de una serie de ensayos y errores, las conexiones entre las neuronas artificiales que llevaron a la acción correcta se fortalecen, mientras que las que llevaron a la acción incorrecta se debilitan. Este sistema, por tanto, no necesita ser programado con reglas fijas, sino que aprende de forma autónoma explotando los datos que posee. Se trata del primer modelo matemático de red neuronal artificial, pero en aquel momento no se disponía ni de los datos ni de la potencia de cálculo necesarios para poner en práctica la teoría.

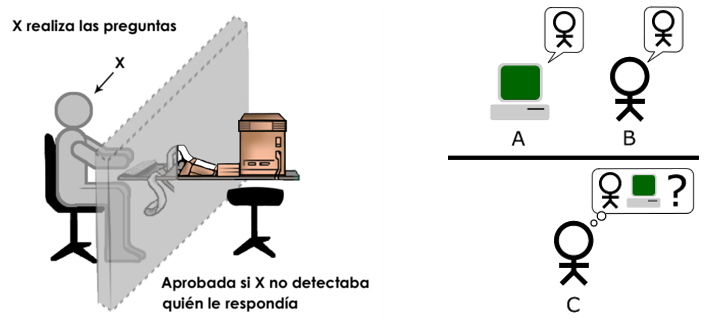

1950: el test de Turing

Hace más de setenta años, el célebre matemático Alan Turing planteó por primera vez (en su artículo “Computing Machinery and Intelligence” la pregunta que aún hoy intentamos responder: ¿pueden pensar las máquinas? Para responderla, Turing propone un método para averiguar si una máquina es realmente inteligente.

Para simplificar, una persona tiene que conversar textualmente con dos entidades sin saber cuál es humana y cuál artificial. Si no puede distinguirlas correctamente, la máquina debe considerarse inteligente. Esta prueba, que al día de hoy ninguna máquina ha superado (y que probablemente debería actualizarse), pasará a la historia como el Test de Turing.

1956: Nace el término “inteligencia artificial”

Es el año de la histórica Conferencia de Dartmouth (New Hampshire, EE UU). En esta ocasión, el informático John McCarthy reúne a una docena de científicos con el objetivo, según escriben en su presentación, de estudiar «cómo cualquier aspecto del aprendizaje o cualquier otra característica de la inteligencia puede, en principio, describirse con tanta precisión que pueda construirse una máquina capaz de simularlo».

El objetivo fracasó, pero fue en esta ocasión cuando el propio McCarthy acuñó un término que, entre enormes expectativas y muchos malentendidos, nunca más nos abandonaría: «inteligencia artificial».

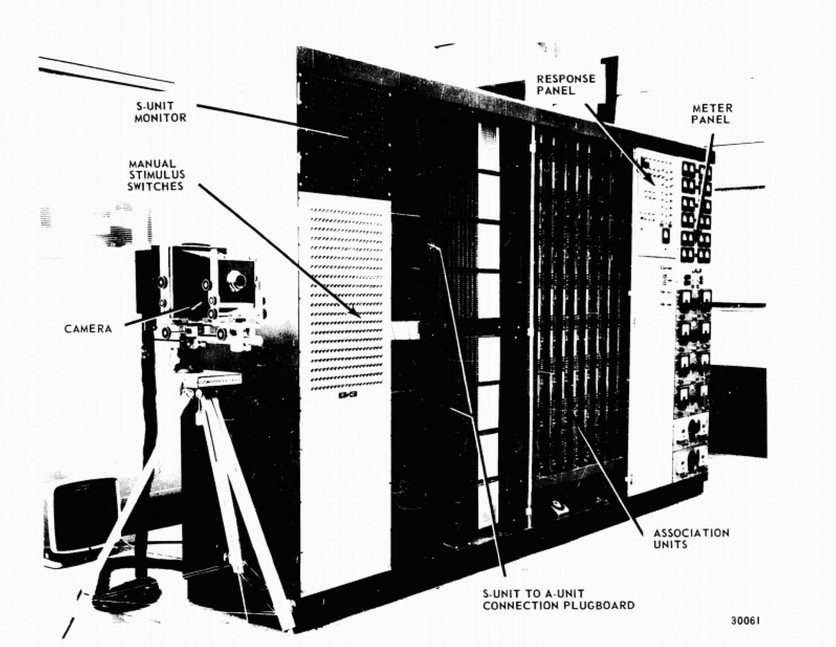

1958: llega el Perceptrón Mark I

«Es el cerebro electrónico que se enseña a sí mismo: dentro de un año será capaz de percibir, reconocer e identificar su entorno, sin necesidad de control o entrenamiento humano», escribía el New York Times en 1958, con motivo de la presentación del Mark I Perceptron.

Creado por el psicólogo Frank Rosenblatt con financiamiento del ejército estadounidense, el Perceptrón es una máquina gigantesca, densamente enmarañada de cables y compuesta de motores y mandos conectados a 400 detectores de luz. Se depositan en él enormes expectativas, que se ven ampliamente defraudadas: dotado de una red neuronal de apenas dos capas y capaz de imitar el comportamiento de solamente ocho neuronas, el Perceptrón es solamente capaz (tras muchos intentos y errores) de reconocer la derecha de la izquierda.

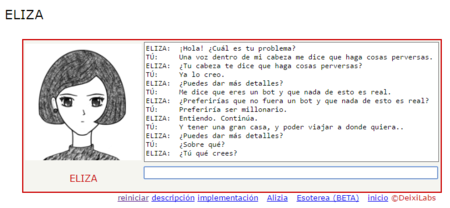

1966: Eliza, el primer chatbot de la historia

No explota redes neuronales y ni siquiera es un ejemplo pionero de aprendizaje autónomo, pero Eliza, creada por el informático Joseph Weizenbaum, es el primer chatbot de la historia. Creada para parodiar a un psicólogo de la escuela rogeriana, Eliza se limita a repetir las afirmaciones de sus interlocutores en forma de pregunta.

Sus capacidades son, por tanto, modestas, pero Eliza genera un enorme revuelo, obligando a su creador a escribir un ensayo entero para explicar que su chatbot no tenía nada de «mágico», y mucho menos de «inteligente». Sin embargo, Eliza marca un antes y un después: es el primer software capaz de interactuar con seres humanos.

1969: el invierno de la inteligencia artificial

En aquella época, las redes neuronales y el aprendizaje autónomo aún no habían alcanzado ningún éxito, y muchos eran los defensores de la llamada «inteligencia artificial simbólica » (en la que la computadora recibe todas las instrucciones para completar sus tareas, en lugar de aprender de forma autónoma). Entre ellos estaban dos pioneros como Marvin Minsky y Seymour Papert, que en un ensayo (titulado Perceptrons) mostraron cómo las redes neuronales, a diferencia de la IA simbólica, solamente podían realizar acciones elementales.

La investigación sobre el aprendizaje autónomo, debido también a los pobres resultados obtenidos hasta entonces, sufrió un duro golpe: se redujeron las inversiones en este campo y se paralizaron los estudios académicos. Comienza el «invierno de la inteligencia artificial», que durará décadas .

1997: DeepBlue derrota a Gary Kasparov

La inteligencia artificial, tras un largo silencio, vuelve a las portadas de todo el mundo cuando el sistema DeepBlue de IBM derrota al campeón mundial de ajedrez Gary Kasparov (que, sin embargo, ganará los siguientes desafíos).

DeepBlue no es una red neuronal, sino una inteligencia artificial simbólica dentro de la cual se han codificado todas las reglas del ajedrez y las jugadas a ejecutar en cada situación. Será el mayor, y por el momento último, gran logro de esta forma de IA.

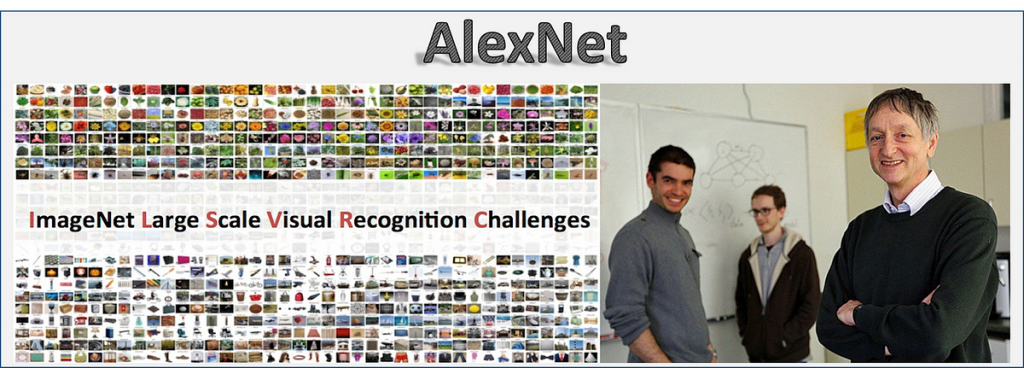

2012: AlexNet gana el concurso de reconocimiento de imágenes

Han pasado más de cuarenta años desde el comienzo del invierno de la inteligencia artificial. Mientras tanto, sin embargo, académicos como Geoff Hinton, Yann LeCun, Yoshua Bengio y otros han seguido trabajando en el potencial de las redes neuronales. 2012 (gracias a la enorme cantidad de datos ahora disponibles a través de la web y las redes sociales y a la creciente potencia computacional) es el año del gran avance para el aprendizaje profundo.

Entre los muchos logros alcanzados en rápida sucesión, el más significativo es probablemente la victoria de AlexNet en el ImageNet Challenge, la principal competición entre software de reconocimiento de imágenes. AlexNet no sólo ganó, sino que destrozó a la competencia. Es la primera vez que el aprendizaje profundo demuestra ser superior a otros sistemas informáticos.

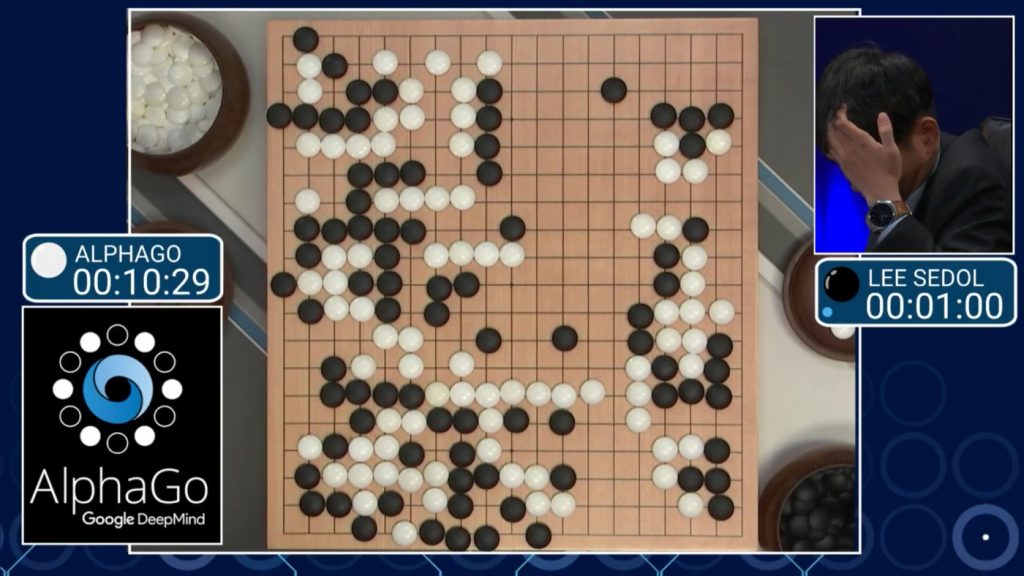

2016: AlphaGo vence al campeón del mundo de Go

Aunque un sistema de inteligencia artificial ya había vencido al campeón mundial de ajedrez, se pensaba que las máquinas nunca dominarían un juego extremadamente complejo y abstracto como el Go. Esta creencia se demostró errónea cuando el sistema de Google conocido como AlphaGo sorprendió al mundo y derrotó a uno de los jugadores de Go más fuertes del mundo, el coreano Lee Sedol. Es una demostración más de las asombrosas capacidades del aprendizaje profundo.

2020: OpenAI presenta GPT-3

En pocos años, los algoritmos de aprendizaje profundo se han extendido por todas partes: seleccionan lo que vemos en Facebook o Instagram, recomiendan compras en Amazon o películas en Netflix, sugieren cómo completar frases en Gmail, y mucho más. En 2020, sin embargo, se produce otro salto adelante: OpenAI presenta GPT-3, su sistema de «procesamiento del lenguaje natural» entrenado a través de 800 gigabytes de datos y equipado con 200,000 millones de parámetros (el equivalente digital de nuestras sinapsis).

GPT-3 demuestra una capacidad hasta ahora desconocida para escribir textos, hasta el punto de producir un extenso artículo para The Guardian. Es el amanecer de las inteligencias artificiales generativas (capaces también de crear imágenes, videos y música basándose únicamente en nuestro dominio del lenguaje natural). Dos años más tarde, en noviembre de 2022, se presentará el chatbot basado en GPT-3: ChatGPT. Desde entonces, el mundo de la inteligencia artificial no ha vuelto a ser el mismo.

Referencia: Wired